A nyári uborkaszezonban különösen nagy vihart kavart, hogy az Amerikai Tudományos Akadémia (National Academy of Sciences – NAS) folyóiratában június 17-én megjelent egy publikáció (Experimental evidence of massive-scale emotional contagion through social networks), mely már címében is jelzi, hogy mi volt a célja: a kutatók azt vizsgálták, hogy bizonyos érzelmi állapotokat, viszonyulásokat lehetséges-e tömeges mértékben „terjeszteni” a közösségi hálózatokon, oldalakon keresztül.

Maga a kísérlet a Facebookon, az angol nyelven kommunikálók között zajlott 2012. január 11. és 18. között. Az eredeti cél állítólag az volt, hogy cáfolják vagy megerősítsék azt a vélekedést, hogy az ismerősök által posztolt különösen pozitív tartalmak rosszkedvűvé teszik az embereket.

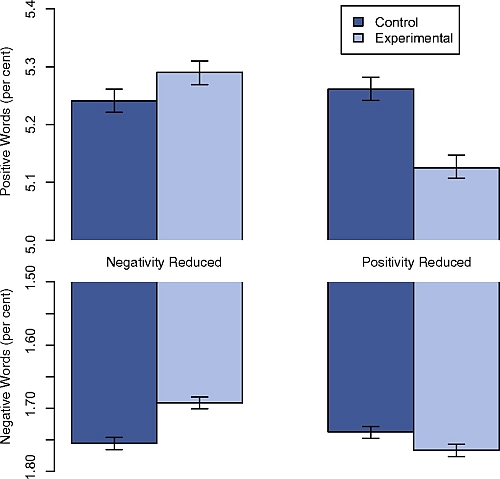

Ez alatt az egy hét alatt a kutatók közel 700 ezer felhasználó üzenőfalát manipulálták, mégpedig úgy, hogy a falon megjelenő tartalmakat, illetve a bejegyzésekhez és képekhez az ismerősök által hozzáfűzött kommenteket a bennük rejlő érzelmi tartalom szerint szétválogatták (inkább pozitív, illetve inkább negatív tartalom), majd a tesztcsoport egyik felénél csökkentették a pozitív tartalmak számát az üzenőfalon, a másik felénél pedig a negatív érzelmeket hordozóak mennyiségét mérsékelték. Több mint hárommillió állapotfrissítést, mintegy 122 millió szót vizsgáltak meg. A bejegyzések közül körülbelül négymilliót inkább pozitívnak, illetve nagyjából 1,8 milliót inkább negatívnak minősítettek.

A vizsgálatot végzők eredményként közlik, hogy adataik szerint egyértelműen elindíthatóak „érzelmi járványok”, ugyanis kiderült, hogy ha a felhasználók sok negatív tartalmat látnak, akkor maguk is hasonló érzelmi állapotba kerülnek, és – kis mértékű növekedést mutatva ugyan, de – inkább ilyen tartalmakat fognak posztolni, illetve fordítva.

Természetesen már az is etikai problémát jelenthet, hogy a felmérést és kísérletet a Facebook és a Cornell Egyetem kutatói a felhasználók értesítése nélkül végezték, de az igazi botrányt nem is ez okozta, hanem az, hogy mindez a szakemberek szerint teljesen szabályosan, a közösségi oldal felhasználási szabályainak betartásával történt.

A módszertani leírásból kiderül ugyanis az a kevesek által ismert tény, hogy a Facebook speciálisan szűrt tartalmat jelenít meg az üzenőfalon: mivel – írják az indoklásban – az egyes felhasználók ismerősei sokkal több tartalmat generálnak, mint amennyit követhetően és élvezhetően meg lehet jeleníteni, ezért saját fejlesztésű algoritmussal válogatnak ezekből, és csak egy részük kerül a falra. Természetesen az ismerősök által végzett összes tevékenység megtekinthető az ismerős idővonalán (bár ez nyilván időrabló és nehézkes), de a falra az kerül, amit az algoritmus relevánsnak és fontosnak ítél meg. Nos, a közlemény szerint a szóban forgó kísérlet is ennek az algoritmusnak egy fejlesztési szakasza és tesztje volt, melynek eredményeit publikálták a kutatók.

Ez utóbbit ma már nyilván bánják, mivel igen nagy felháborodás fogadta a közleményt. Annyira, hogy Adam Kramer, a közösségi oldal speciális csoportjának (Data Science Team) kutatója – bár megvédi a kísérletet és igyekszik megnyugtatni minden aggódót – kénytelen volt saját Facebook-oldalán bocsánatot kérni a felzaklatott felhasználóktól. A cég hivatalos közleményében ugyanakkor jelezte, hogy a tanulmány nem konkrét, azonosított felhasználókról szól, nem sérti a magánszférát, sőt, a munka célja épp az, hogy a minél relevánsabb tartalmak megjelenítésével növeljék a felhasználók elégedettségét, segítsék tájékozódásukat, javítsák a kapcsolattartás minőségét.