- Microsoft Excel topic

- Windows 11

- Vírusirtó topic

- DIGI kábel TV

- Opera böngésző

- Újabb robottaxis balesetekre derült fény

- Hódít az AI, közben a Microsoft emberek százait küldi el a felhős részlegétől

- ASUS routerek

- Nehezebb lesz a dolga a Temunak Európában

- Felfordul a windowsos piac: az Arm megszerezné a PC-s piac 50 százalékát

-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Már Volta óta tudni mire való. Egy tensor mag az 64 db speciálisan összedrótozott FMA ALU, ami egy órajel alatt képes egy D = A + B * C mátrixművelet elvégzésére, ahol A pedig egy-egy 4x4 FP32 (vagy FP16) mátrix és B és C pedig egy-egy 4x4 FP16 mátrix. Turing óta van INT8 és INT4 támogatás is, mely 2x illetve 4x sebességű mátrix FMAC-ra képes.

A RIOS rendkívül felhasználóbarát, csak megválogatja a barátait.

-

#45185024

törölt tag

Tudom tudom a ray tracing amit kb pár játék használ. Meg a DLSS-re (kb 20 játék) ami egy képfeljavító eljárás csak épp pont arra nem alkalmas vonalaknál, szörnyű eredmények jönnek ki. Ez is a címe a cikknek A DLSS alternatív, de nem helyettesíti az Ultra HD-t

De mi nem erről beszéltünk hanem egy ezévben kijövő dologról

a PH is írt már pl a shader model 6.5-ről

"DirectML API-hoz való, és tulajdonképpen bevezeti a compute eszközök kihasználhatóságát."Minket itt az érdekel...

(hiszen egy AMD szobán miért is kérdezgetnél a tensor magokról ugye???)

szóval az érdekel és ez volt a téma hogy dedikált egységek NÉLKÜL hogy lehet ML-t használni és még mire lehet jó az MI. Te is olvasgass VSezni pedig nem fogunk itt ezért direkt csak a kedvedért átvittem a témát VSbe is ...egy kicsit pahasztosan kicsit helyeírási hibásan

VSezni pedig nem fogunk itt ezért direkt csak a kedvedért átvittem a témát VSbe is ...egy kicsit pahasztosan kicsit helyeírási hibásan  ott nyugodtan nyomjad.

ott nyugodtan nyomjad.[ Szerkesztve ]

-

Ribi

nagyúr

Linkelt tesztnél is elfelejtik megírni, hogy az 8 gigás vega miért teljesít HBCC nélkül is sokkal jobban mint a 2080. Gondolom ilyenekre kár is kitérni. Vagy csak "jól" kell tesztelni.

Illetve más FC5 frame time tesztekben közel sem ilyen tüskés eredmények jönnek ki.[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Az AMD-t nem érdekli igazából, hogy milyen gondok vannak szoftveres szinten, amitől a VRAM nem használható hatékonyan. Nekik a Vega óta van hardveres memóriamenedzsmentjük. Egy sorral lehet kezelni ezt a problémát a hardvereiket, vagy ha erre is képtelenek a fejlesztők, akkor a driverben bekapcsolható a HBCC szegmens, és konfigurálható a mérete is. Szóval a Vega esetében, ha egy program kér mondjuk 16 GB-ot, akkor annyit kell tenni userként, hogy megnyitod a Radeon Settings programot, 16 GB-ra húzod, majd alkalmazod, és máris 16 GB-osnak látja minden program az amúgy 8 GB-os VGA-d. Ezt egészen 64 GB-ig meg tudod tenni.

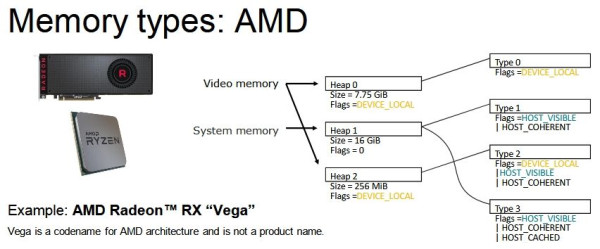

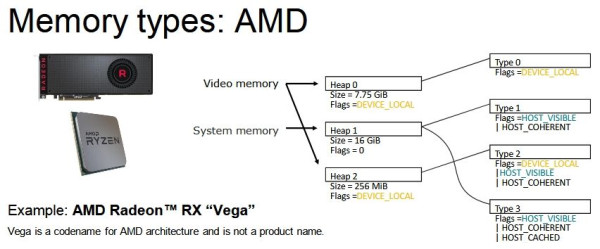

(#40332) Ribi: Az teljesen driveres tényező. Az AMD és az NVIDIA eltérően menedzseli szoftveresen a memóriát. Az AMD DX11-ben is egy nagy 7,75 GB-os szeletként használja (plusz 256 MB-os gyorsítószelet), míg az NVIDIA 8 darab 1 GB-os szeletként. 8 darab 1 GB-os kiosztás esetében gyorsabban fragmentálhatók a szeletek, tehát hiába van összességében ugyanannyi VRAM, hamarabb elfogy. Ez tisztán szoftveres probléma, nem a hardver tehet róla.

A Far Cry 5-höz adtak ki textúracsomagot. Azt nem szokás a tesztekben telepíteni, mert nagyon megnöveli ám a játék VRAM-igényét. Itt telepítve volt, ezért más a frame-time.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

HSM

félisten

Nekem csak a kezdeti árazás volt a bajom.. Mikor megjelent, itthon 130K-ért volt pár darab, aztán a bányaláz felvitte az árát 200K közelébe, annyiért azért már nem találtam annyira jó vételnek.

Kíváncsi leszek, hova és milyen áron fogják pozicionálni a Navikat.

Engem nem érdekel, ha lassabb lesz, mint a 2080Ti, ha korrekt hozzá az árcédula. -

Tyrel

őstag

Amíg csak a Bitcoin erős addig ugyan nem, már az előző bányászláz alatt sem lehetett videokártyával csákányozni...

Ha valamelyik olyan Altcoin-t felkapják ami videokártyával csákányozható, abból tud a baj lenni, magából a Bitcoinból nem. A legutóbbi, Polaris/Vega tönkreb*szó bányászláz alkalmával ez ugye az Ethereum volt, de már arra is gyártanak ASIC-ot, így a Navi-ra nem jelent már veszélyt. Hogy jön-e helyette másik népszerű, GPU-bányászható Altcoin azt meg a franc se tudja biztosra, de szerintem nem fog...

Meg persze - ha az AMD nem hazudott - akkor az RDNA kevésbé compute-orientált mint a GCN volt, így talán kevesebb bányász-algoritmus is fut rajta jól...

[ Szerkesztve ]

Turenkarn

-

#82819712

törölt tag

A videokardz-nak van a legjobb összefoglaló oldala, annyit lehet elmondani hogy a Radeon 7-nél nem volt eltérés. Navinál majd 7.-én feltöltik.

Nyugodtan vedd meg a legolcsóbbat, ha van is minimális az csak ilyen márkaizmozás.

A garanciaidőt viszont nézni érdemes.

Egyetlen kivétel van az RX 5700 XT Boost Frequency Up to 1905 MHz

RX 5700 XT 50th Anniversary Boost Frequency: Up to 1980 MHz

De ez utóbbi drágább is.

Várni kell kicsit hogy összecsiszolódjanak a 2060 super 2070 super áraival, és megnézni az 50. évfordulós kártya tesztet hogy válogatott e a GPU vagy erősebb e a hűtés, ha nem akkor te is beállítod kézzel.[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Kell oda is 100-200 TFLOPS. Azért nem mindegy, hogy meddig lövöd a sugarakat, stb. De 30-40 TFLOPS-ból már valóban lehetne alkotni. Viszont igazán jó eredményhez még nem elég.

A mai hardverek semmilyen normális megoldásra nem jók. Felesleges ezekhez hasonlítani bármit. Majd kiforr ez az egész 2021 környékére, amikor az API is rendbe lesz rakva. Akkortól lehet elkezdeni az igazi fejlődést. Addig ilyen porba fingások lesznek, mint ma. Valahol beüt valami limit, például sávszél, vagy a fixfunkciós hardver geometriai korlátja, és vége is a lehetőségeknek. Ezek a limitek ma elég alacsonyak, de két generáció múlva már elég használhatók lesznek.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Nem mondtam, hogy csak a PT lehet fotorealisztikus, de eleve a fotorealizmustól még évtizedekre vagyunk.

Én problémát látok a Control esetében. Csupa zajt. Vagy normálisan csinálják, vagy akkor nem éri meg.

A geometriai részletesség a fixfunkciós motor oldalán probléma. Annak megvannak a határai. Nem kezel egy bizonyos mélységű BVH-nál többet, mert nincs benne hozzá elég erőforrás. Emiatt van az, hogy sokáig tart az RT-t ma belerakni a játékokba, mert megírni gyorsan megírod, de utána ellenőrizni kell, hogy sose legyen olyan jelenet, amikor a fixfunkciós motor határát túlléped, különben nagyon sokat romlik a sebesség. Ugye a döntő probléma most, hogy nincs megadva, hogy pontosan mit csinál ez a fixfunkciós hardver, vagyis csak a gyakorlati mérés az, ahol meghatározhatók a limitek. A Shadow of the Tomb Raider esett ebbe bele. Meg volt ígérve a patch szeptemberre, és hónapokkal később jött, mert rengeteg objektum geometriáját át kellett tervezni, hogy jó sebességű legyen. Pedig a kódot megírni valóban egyszerű, az tényleg nem több pár napnál, csak ha véletlenül alig fut, akkor nincs igazán más lehetőség, mint visszavenni a geometriai részletességet, ha viszont ez túl nagy áldozattal jár, akkor át kell tervezni, optimalizálva egy olyan köztes állapotra, ahol még nem csúszol ki a hardver limitjéből, de még a geometria is jól néz ki.

(#44039) gbors: Tudtommal nem így oldják meg. Ha beraksz az IGP mellé egy Xe GPU-t, akkor azt egy nagy GPU-nak mutatja a rendszer felé. Az persze ködös, hogy ezt hogyan, de hasonló lehet, amit az AMD kísérletezik az IF-fel. Ott is meg tudják oldani, hogy két Vega 20 egy nagy Vega legyen, és a játék is egy erőforrásként értelmezi. Viszont ez még kísérletezés.

(#44041) Petykemano: Szerintem az nem működne. Mármint lehet rá írni programot, de általánosabb megoldás kell. Az AMD-nél annyit tudni, hogy létezik egy olyan dizájn, ami két Vega 20-at kapcsol össze egy nagy GPU-vá. A rendszer felé egyetlen egy GPU-nak látszódik, és így értelmezik a programok is. Ennek nincs olyan előfeltétele, ami mondjuk az Intelnél nincs meg. Az AMD IF-fel köti össze, míg az Intel UPI-val. Ha van már egy memóriakoherens interfészed, akkor ez az egész kivitelezhető. Az egyetlen gond vele a GPU-k vezérlése. A mai parancsmotorokat nem arra tervezték, hogy több ilyen hardvert ellássanak. Tehát kell egy olyan parancsmotor, amely figyelembe tudja venni, hogy az a GPU, amiben dolgozik, elrejt a rendszer elől egy másik GPU-t, és aszerint tudja szétosztani a feladatokat. Ez ma hiányzik, de nyilván nincs különösebb akadálya a következő generációba belerakni. Ma még valószínűleg a CPU felől emulálják a tesztekhez.

Az a lényeg, hogy az Intelnek ugyanúgy megvan ehhez mindene. Tudom az AMD szétmarketingelte az Infinity Fabricot, de nem olyan egyedi dolog ez, amihez hasonló nem létezne az Intelnél, talán nem olyan gyors interfész van rá, de működik.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

AZ AMD és az NVIDIA nem ajánl játékokat.

Mi pedig explicit API-t használó játékokkal tesztelünk, mert explicit API-ra tervezett hardverek jönnek a piacra, és ma már szinte mindegyik nagy cím rendelkezik Vulkan vagy DX12 leképezővel, esetleg mindkettővel.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A gyártó döntésétől függ. Az AMD néha leveszi róluk a védelmet, így publikusan is megnyithatóvá vállnak. Valaki fel szokta tölteni, a Videocardz-nál volt rá példa. Az NV nem szokta, ott egyedi belépés kell a megtekintéshez, amíg a guide-ot nem törlik. Ha ez megtörténik, akkor már az egyedi belépővel sem nyitható meg.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

KillBorn

senior tag

Jövő tavasszal szeretném lecserélni az RX480-at. Ha jövőre jön új széria az AMDtől, akár az év második felében, az eddigi hírek alapján nem érné meg nekem megvenni az 5500XT-t az RX590 körüli teljesítményével. Nagyjából 3 évig használok egy vga-t, az RX480 még éppen bírja 1600x900-en ~ultra-n (Control, FallenOrder, FarCryok, ACk, Rage2, TombRaiderek). Jó lenne feljebb lépni 1080p-re. Az 5700 drága nekem. ~100k körül szánnék az újra. Pont a kettő közötti résbe lenne nekem jó valami a következő 3 évre, de ha nem jön, és jövőre tényleg cserélik az RDNA-t, inkább kispórolom annak az újnak az árát. De ha jönne egy 5600XT 8GB mondjuk, az pl. szerintem már elég lenne. Zöld oldalon ha szerettem volna, már találtam volna az 1660Ti-t. De már évek óta AMD-re vagyok berendezkedve.

"I guess your purge wasn't efficient enough, Vader!"

-

Abu85

HÁZIGAZDA

Persze, hogy nem volt áresés a bányászláz után, csak a nagyon luxusárazások dőltek be. Igazából áremelés jön még. De pont a piac szűkülése okozza ezt, hiszen ha kevesebb a potenciális vevő, akkor kevesebb eladásból kell realizálni ugyanazt a bevételt. Emellett az új node-ok drágábbak. Egy lapka tape-out-ja 7 nm-en nagyjából dupla annyiba kerül, mint 1x nm-en, tehát egy VGA-nak most már kétszer annyi tervezési költséget kell visszahozni.

Erre egyébként az Intel és az AMD kitalált valamit a következő évekre. A CPU-val csomagban adják majd a GPU-t. Így ugyan a VGA-k továbbra is drágák lesznek, de a procikon a haszon sokkal nagyobb, tehát tudnak annyit engedni az OEM-eknek a VGA tekintetében, hogy végeredményben a CPU+VGA költség alacsonyabb legyen. Az Intelnél láttam, hogy ők ezt ki akarják terjeszteni a dobozos piacra is, tehát alaplap+VGA+CPU szintű csomagok lesznek, így ugyanaz a három komponens lényegesen olcsóbb lesz, mint egyenként megvásárolva. És a VGA-n való kiesést az Intel pótolja a gyártópartnernek a proci nyereségén. Abban egyébként nem vagyok biztos, hogy ez legális. Dobozos szinten talán rámondható, hogy az, de OEM szinten gyakorlatilag árazópisztolyt tartana az Intel és az AMD a partnerek fejéhez.

Konzolok egyébként eddig is voltak. Most ha tartanak tőlük, akkor sem lehet mit kezdeni velük. Túl nagy előnye van a speciális platform miatt a hardvernek, mert a gyártók előállítási költség alatt is el tudják őket adni. Az NVIDIA biztos nem akarja előállítási költség alatt árulni a VGA-it. Ha a piac nem vevő ezekre haszonnal, akkor nincs értelme a piacnak. Ilyen szempontból a konzolokat nem érdemes számításba venni az árazásnál. Ami az NVIDIA számára fontos lenne az a Cloud, mert ha így emelkednek az árak, akkor lényeges az egyik nagy szolgáltatásba bekerülni. A Google, a Microsoft és a Tencent már kiesett, de még ott van az Amazon. Őket meg kellene győzni, hogy ne AMD-t vagy Intelt vegyenek cloud gamingre. Ez sokkal fontosabb tényező az NVIDIA-nak, minthogy a konzol miatt rágják a körmüket. Némileg hátrány, hogy az AMD és az Intel platformot kínál.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A 4K 60 fps-t bármin meg tudod oldani. Az egész csak konfigurálás kérdése. Ettől még ugyanúgy jöhetnek az új konzolokra is olyan játékok, amik mondjuk 4K 30 fps-re vannak konfigurálva. Tehát az nem igazán fog változni, hogy ha kiadsz ~5000 dollárt egy csúcs-PC-re, akkor az a jövőben is gyorsabb lesz, mint egy 500 dolláros konzol, ráadásul a PC-t már az elavult API-k sem hátráltatják, a DX12 és a Vulkan nincs annyira messze a konzolos API-k képességeitől. Meg ugye a lényeg, hogy végre skálázódnak, tehát ha nem is tudnak annyira kevés utasításszóból megoldani egy rajzolási parancsot, mint a konzolok, akkor is veszel nyolc mag helyett 12-t, és behoztad ezt a hátrányt. 16-tal felül is múltad őket, és vehetsz akár 32 magot is. Tehát a PC-nek ezekkel az API-kkal a teljesítményelőnye vitathatatlanul megmarad, illetve pusztán pénzkérdés lesz az egész, nem egy szoftveres limit határozza majd meg. Az már nyilván egy másik kérdés, hogy az ebből származó minőségi előny megéri-e +4500 dollárt, ha most a közel csúcskonfigurációkat nézzük.

A VRR sem új, Xboxon most is van, és nem kell hozzá HDM 2.1, hogy működjön. Az egér-bill részletkérdés. Egyre többen játszanak PC-n gamepadről. Azt veszem észre, hogy én is, egyszerűen kényelmesebb. Persze vannak olyan játékok, ahol ez hátrány, de sokszor nem az.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A mérési hiba az más. A helyzet nagyon egyszerű. Valójában még az x16-os PCI Express 4.0 sávszélessége is kevés a VRAM sebességéhez képest, tehát erre nem éri meg erősen építeni a szoftver oldaláról. Ugyanakkor egy játék is belefut helyenként olyan limitekbe, amelyek ugyan léteznek, de mindössze a teljes játék 0,0000000000000001%-át alkotják. Tehát ha információd arról, hogy az adott játék milyen jelenetsor során terheli a legjobban a PCI Express interfészt, akkor kizárt, hogy ki tudd mérni a 2.0, a 3.0 és a 4.0 között a különbséget. De ha erről van tudomásod, akkor sokkal egyszerűbb a helyzeted, mert tudatosan fel tudod úgy építeni azt a tesztet, hogy a játéknak azt az aprócska szeletét erőltesd, és ott már lesz különbség a csatolók között. Csak ahogy írtam ez mond rendkívül mesterséges körülmény, ami a valóságot nem reprezentálja, így ha ezeknek a körülményeknek az előállítására nem törekedsz tudatosan, akkor azt az eredményt kapod a PCI Express befolyásolása szempontjából, amit a TPU kapott. Ezt linkeltem a hsz-ben, amire reagáltál.

Ahol a PCI Express 4.0-s VGA igazán számít azok a professzonális alkalmazások. Ott azért találni olyan feladatot, ahol van olyan valós körülmény, ahol ebből előnyt lehet kovácsolni. Mi is találtunk: [link] - akinek erre kell VGA, nyilván törekedjen PCI Express 4.0-ra, de játékra igazából felesleges, mert a játékmenet 99,9999999%-ában nincs előnye, a maradékot pedig túl lehet élni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Cathulhu

addikt

Ez meg csak nem is leak, csak rumor, azzal meg mindig padlast lehet rekeszteni. Szvsz ebbol semmi se igaz, de hetfon hatha kiderul valami konkretabb.

De szigoruan elmeleti alapon meg akar mukodhet is, csak 1.5x annyi tranyo es 7nm EUV nem indokolna jelentos TDP novekedest, persze minden a celzott orajeleken mulik. Az RDNA 2 meg hozhat plusszban IPC novekedest is.

Amik miatt nekem buzlik ez a rumor, egyreszt az a 1.5x tranyo mennyisegre 2x die area-t ir, ugy hogy kozben a csikszelesseg is csokken, masreszt meg az RDNA1-es paletta is szegenyes, 2-t nem varok ev vege elott.Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

Abu85

HÁZIGAZDA

Nem igazán bénázhat még. Nem véletlenül jelölte meg Krzanich azt a célt, hogy az AMD nem viheti 20% fölé a szerverpiaci részesedését. Az lehet, hogy ezt talán az új CEO már másképp látja, de abban baromira igaza van Krzanich-nak, hogy a 20%-ból könnyebben lesz 50%, mint az 5%-ból 20%, és ez kritikus tényező az Intelnek.

Nem állunk meg. A jelenlegi útitervekben az Intelnél és az AMD-nél is 200+ mag szerepel, legalábbis ameddig mennek a tervek.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Offline ez bevált dolog, de a real-time nem ennyire egyszerű. Utóbbinál azért nagyobb hátrány az adatmásolás per sugár, mint annak az előnye, hogy külön dedikálsz a sugárkövetésre egy GPU-t.

Ami működőképes lehet az a teljes feldolgozás felosztása, például AFR-rel, vagy SFR-rel, de leginkább valami scissor modellel. Vagy írnak egy olyan motort, ahol az árnyalás függetlenített a leképezéstől, így pedig az árnyalási munkák leoszthatók egy csomó GPU-ra, és lenne egy szem fő GPU, ami csak a leképezést csinálja.

A DXR 1.0, a DXR 1.1, illetve a Sony megoldása is brute force. A különbség az, hogy mennyire pazarlóan vagy hatékonyan bánik a rendelkezésre álló hardverrel. De az eredményük ugyanaz. Itt gondolj arra, hogy a megjelenített kép tekintetében a DirectX 11 is ugyanazt csinálta, de eközben a DirectX 12 többszálú optimalizálásával egy csomó rajzolási parancsra levetítve sokkal gyorsabb. Mindkettő API brute force, csak az egyik pazarló, míg a másik hatékony. A DXR 1.0 és a DXR 1.1 esetében nem mindegy, hogy például a DXR 1.1-gyel már amikor találatkor, vagy találat nélkül a függvény visszatér, akkor helyből ott a kontextus struktúrája a shaderben. Nem kell azt bekötni, hogy egyáltalán folytatni lehessen a számítást a hit vagy miss shaderrel. Egy csomó adatmozgást megszüntetsz ezzel a lapkán belül, miközben a számítás része ugyanaz marad. Ha ez nem számítana, nem nyomtak volna egy ekkora resetet az inline raytracinggel.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Azt nagyon sokára fogják elérni a játékfejlesztők. Talán 2030-ban. És valószínűleg segítene, ha rakhatnál mondjuk 8 GPU-t egy gépbe, de ehhez tényleg kell egy Nitrous-szerű motor. És akkor újra ott vagyunk, hogy pénz és idő.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Még úgy is sok terhelés sajnos. Majd úgy két generáció múlva.

(#47109) X2N: Még nincs olyan denoiser, de a Microsoftnak rengeteg aktív projektje van az Xbox Series X-hez, amelyek még nincsenek kész. Ezek között AI felskálázó és denoiser is van. Ezek természetesen direkten menthetők PC-re is. Szóval annyira nem reménytelen a helyzet.

(#47110) Jack@l: Olvasd el, amit X2N írt. Ezek miatt a raszterizálás egy ideig marad. Évekig még. Az effektek szintjén azonban a sugárkövetés aktívan alkalmazható.

Mint írtam a PlayStation 5-ből nem szabad kiindulni. Annak az API-ja olyan algoritmusokat enged meg, amelyekre a DXR 1.1 sincs felkészítve a compute shaderből szabadon konfigurálható BVH bejárás hiányában. Ekkora szoftveres hátszéllel könnyű arcoskodni, de valójában az egész csak szoftver. A PC-s hardverek is képesek lennének ugyanerre, ha lenne hozzájuk megfelelően megszabott specifikáció az API oldalán. De mint írtam a gyártók egyelőre nem egyeztek meg arról, hogy legyen egységes BVH adatstruktúra-formátum, így pedig nehéz szabványosítani a Microsoft számára, mert többféle különböző adatstruktúra-formátumra nem tudják felhúzni a teljesen konfigurálható BVH bejárást.

A hibrid RT nem kötelező. A PlayStation 4-re is van csak sugárkövetéssel dolgozó, nulla raszterizálást alkalmazó játék. Valószínűleg lesznek olyanok, akik az új generációban is megpróbálkoznak ezzel, de mindenképpen limitációkat jelentenek a mai hardverek. Meg a pár generáció múlva érkezők is.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Cathulhu

addikt

"AMD_MickeyRadeon Community Team49 points · 3 days ago

I've seen reports regarding Vega 56/64 performance in Horizon Zero Dawn and passed it on to our team to investigate."Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

Abu85

HÁZIGAZDA

A memóriahasználat az allokáció hatékonyságától függ. Minél hatékonyabb, annál jobban kitölti a rendelkezésre álló VRAM-ot. Ez alapvetően feature, de sok függ magától a driverből, mert DirectX 11 API-ban a driver kontrollálja ezt, míg DirectX 12-ben az alkalmazás. Viszont a probléma mindkét API esetében ugyanaz: a streaming motorok esetében az a jó, ha a lehető legtöbb memóriát felhasználja a rendszer, ugyanis ilyenkor később kell majd allokációt törölni. A DirectX 11 alatt nem tudni, hogy milyen szegmentálást alkalmaznak a gyártók, mert ott ugye a meghajtó mögött el van rejtve a memória, így nem látszik a fejlesztőeszközök felé gyakorlatilag semmi. De a hardver számára van egy ideális szegmentálás, és valószínűsíthető, hogy a DirectX 11-ben a memória felosztása hasonló ahhoz, ahogy DirectX 12-re felosztják, utóbbi API viszont közvetlen memóriamenedzsmentet enged, tehát látszik a szegmentálás.

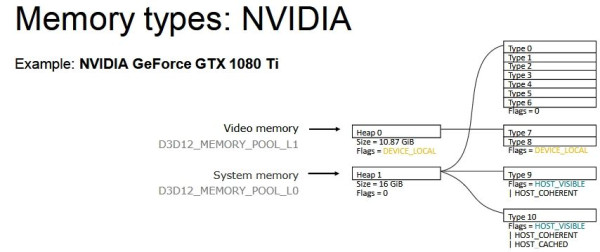

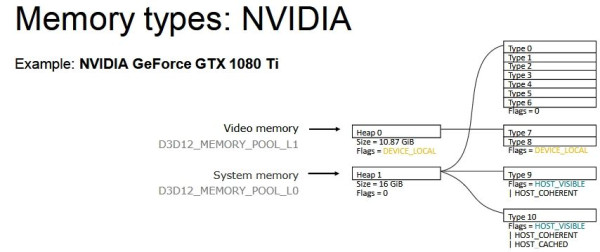

Az NVIDIA így szegmentál:

Míg az AMD így:

A különbség ebből ered, hogy az NVIDIA nagyon sok felé osztja a memóriahalmazokat, és mindegyik memóriahalmazon belüli type szegmenst külön kell kezelni, vagyis az allokációkat is erre a leosztásra kell tervezni. A VRAM-ot tekintve az a lényeg, hogy az NVIDIA a teljes VRAM-ot eszközlokálisan használja, viszont nem egy, hanem két eszközlokális type szegmens alatt, vagyis elképzelhető, hogy hiába van még az adott VRAM-on belül akár 1 GB-nyi szabad memória, a töredezettség akkora lehet két szegmens szintjén, hogy az új allokációk egy részének már nem található akkora összefüggő terület, ahova beférnének, így allokációkat kell törölni.

Az AMD 256 MB-ot minden rendszer VRAM-ják host felé látható és koherens memóriának használ, ahova főleg puffereket dobnak be, ezek nem igazán változnak. Ennek a lényege, hogy ezeket a puffereket a GPU többször címezi, mint a CPU, így jobb ha a GPU-hoz vannak közel. Az NVIDIA-nak is van ilyenje, de a rendszermemóriában, így náluk nem a CPU megy a VRAM-ig, hanem a GPU a rendszermemóriáig az adatokért. A maradék terület az eszközlokális halmaz, és csak egy type szegmens van rá alkalmazva, vagyis nincs logikailag két részre vágva. Ezzel nagyobb esély van rá, hogy ha van benne amúgy 1 GB-nyi szabad terület, akkor a nagyobb allokációk még beleférnek, így nem kell törölni más allokációkat.

A töredezettség miatt nagyon ezzel nem lehet mit kezdeni, olyan ez, mint a HDD-n az adatok töredezettsége. Tehát hiába streaming a motor, akkor sem lesz annyira hatékony a hardverek memóriahasználata, hogy igazán jól megközelítse a rendelkezésre álló területet. Azaz jó legyen a kihasználás. A legjobb kihasználáshoz lapalapú modell kell, mert ott minden allokáció gyakorlatilag egy 4 kB-os lap lesz, és nincs töredezettség. Úgy már ki lehet használni a rendelkezésre álló memóriát, vagyis egy program egy például 7,75 GB-os eszközlokális type szegmensen tényleg 7,75 GB-ot fog felhasználni nem csak 6-6,5-öt, stb. A next gen konzolokban ez a modell lesz, és majd csak beesik a PC-re is egy szabványos API, ami kezeli a lehetőséget.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ki lesz majd adva a GDDR6X speckó a termékek megjelenésekor.

(#47672) X2N: Régen leírtam, hogy a hotspotban az a lényeg, hogy a hardver leméri. Régen volt a lapkában egy helyen dióda, de ha nem pont ott volt a lapka legforróbb pontja, akkor azt a dióda nem tudta lemérni. Tehát mért mondjuk 90°C-t, de közben egy másik helyen már volt 110°C is a lapka, csak nem volt rálátás.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Robi BALBOA

őstag

Nem kell messzire menned, néz meg egy gddr5 vagy gddr5x speckót.

Volt GTX Titan Black-em, ügye a 6gb vram miatt volt a nyák hátuján is memória, na egyszer véletlenül rányúltam, hát nagyon megégetett, aztán elkezdtem kutakodni, hogy másoknak mi a tapasztalata ezzel, több tesztoldalon is 110°C-ot mérték, és ez volt az üzemi hőfoka.

Mondjuk én egyből vettem rá minőségi ram süniket és kapott is rendesen levegőt, szerintem az le vitte ilyen 70-80fokra, ami biztosan jobban tetszett neki.Tuning mindenek felett! Legjobb a Legrosszabb! by Karesz:) , Én: és mivel iszod a Vodkát Karesz? Karesz: Hát,Ö?!?> Haverokkal!:) , Nem az a lényeg honnan jössz, hanem, hogy mit ISZOL!!! by-Bekő Lacika- /Abit és Fatal1ty alaplapokat Keresek!/

-

-

Jack@l

veterán

Amirpl te beszélsz az a path-tracing. De ott is van mód rá, hogy frametime-ot, fps-t mérj.

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

KillerKollar

senior tag

Minél magasabb a felbontás annál kevesebb az esélye a CPU bottlenecknek, mivel a felbontás csak a GPU-nak jelent többlet terhelést, a CPU-nak nem. És a CPU bottleneck sem úgy működik, hogy van vagy nincs, jelenettől függ, ha épp több dolgot kell számolni a CPU-nak és kevesebbet a GPU-nak akkor CPU bottleneck van, ha bejön egy olyan effekt amit a GPU számol és leesik tőle a framerate akkor épp a GPU a bottleneck, így nem kizárt, hogy alacsonyabb felbontáson is nőhet valamennyivel az átlag fps. Mondjuk egy 3080 720p-ben valószínűsíthetően majdnem mindenhol CPU bottleneckes lenne.

-

VirsLee

őstag

A józan ész?

Ennél azért szakmaibb válaszra számitottam...

Ennél azért szakmaibb válaszra számitottam...

Néztem pár videót, ahol monitorozták a vram használatot is 1440p-ben és 4k-ban is. Tényleg nem tudom mi indokolja, hogy több legyen. Ezért vártam szakmai választ, nem azt, hogy "eddig 8 volt, legyen má' több", vagy a "józan ész", esetleg valaki még mondhatná, hogy "mindig többet szoktunk venni, mint amennyi vót".

Szóval ha van valami szakmai érved annak örülnék, mert én most fogok kártyát venni 4k-ra, de még nem tudom milyen lesz. Gyakorlatilag 3070 és 6800XT a két fő esélyes. -

VirsLee

őstag

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Állásajánlatok

Cég: Ozeki Kft.

Város: Debrecen

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

VSezni pedig nem fogunk itt ezért direkt csak a kedvedért átvittem a témát

VSezni pedig nem fogunk itt ezért direkt csak a kedvedért átvittem a témát

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Valamennyit számít, de messze nem annyit, mint hiszitek.

Valamennyit számít, de messze nem annyit, mint hiszitek.